Régime juridique applicable, finalité du traitement, analyse d’impact, conception du système… Comment créer des bases de données d’apprentissage pour un système d’intelligence artificielle conformes au RGPD ?

Pour répondre à ces questions, la CNIL a ouvert fin 2023 une consultation sur la constitution de bases de données d’apprentissage et a publié neuf fiches pratiques afin d’aider les professionnels à concilier innovation et respect des droits des personnes. Ces fiches concernent uniquement la phase de développement, à l’exclusion de celle de déploiement. Les contributions issues de la consultation publique seront analysées pour permettre la publication de fiches définitives, en 2024, sur le site web de la CNIL.

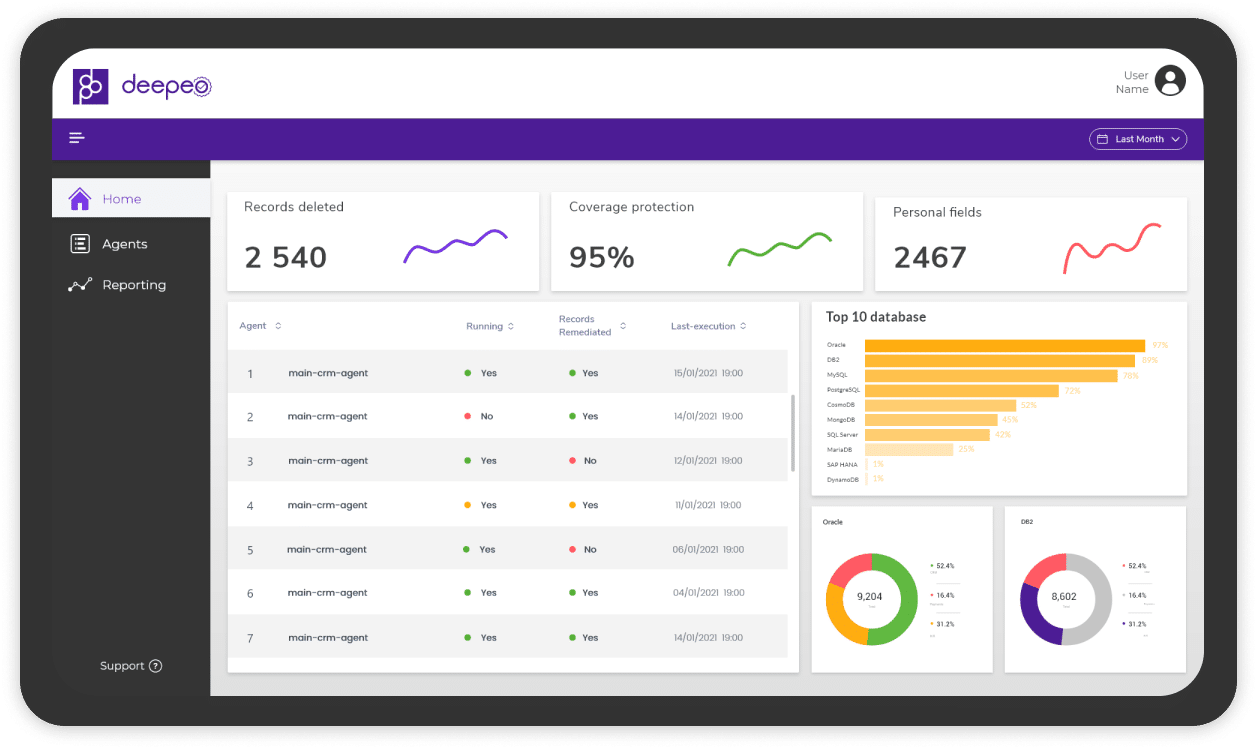

Les recommandations de la CNIL doivent permettre d’accompagner un large nombre de professionnels aux profils aussi bien juridique que technique, tels que délégués à la protection des données (DPO), professionnels du droit, personnes disposant de compétences techniques spécifiques ou non à l’IA, etc. La solution logicielle Deepeo tient compte justement des exigences de l’organisme de contrôle.

Les systèmes d’IA concernés sont les systèmes reposant sur la collecte et l’utilisation de données personnelles, à savoir les systèmes d’apprentissage automatique (systèmes statistiques/stochastiques), l’apprentissage supervisé (à partir de données annotées), l’apprentissage non supervisé, l’apprentissage par renforcement. Les systèmes se fondant sur la logique et les connaissances (systèmes déterministes) rentrent également dans le périmètre, notamment la programmation inductive (logique), les systèmes fondés sur les bases de connaissance, les moteurs d’inférence et de déduction, le raisonnement symbolique et les systèmes experts.

Déterminer le régime juridique applicable

La première étape à respecter pour être conforme au RGPD consiste à déterminer le régime juridique applicable aux traitements de données en phase de développement du système d’IA. Si l’usage opérationnel du système d’IA en phase de déploiement est défini dès la phase de développement, et si les traitements mis en œuvre en phase de développement poursuivent exclusivement la même finalité que ceux en phase de déploiement, il est alors possible de considérer qu’ils relèvent, généralement, du même régime juridique.

En revanche, si l’usage opérationnel du système d’IA en phase de déploiement n’est pas clairement défini dès la phase de développement (système d’IA à usage général), le régime juridique de la phase de développement ne sera pas systématiquement le même que celui déterminé en phase de production.

« On considère en général dans cette hypothèse, sous réserve d’une analyse au cas par cas, que les traitements en phase de développement sont soumis au RGPD. Cela n’exclut toutefois pas, selon l’usage opérationnel du système d’IA, que les traitements de données en phase de

déploiement soient soumis au régime ‘police-justice’, s’ils sont mis en œuvre par une autorité compétente à des fins de prévention et de détection des infractions pénales, d’enquêtes et de poursuites en la matière ou d’exécution de sanctions pénales », rappelle la CNIL.

Définir la finalité du traitement

La deuxième étape est la détermination de la finalité du traitement de constitution d’une base de données d’apprentissage d’un système d’IA. Conformément au RGPD, la finalité doit être « déterminée, légitime et explicite ».

L’exigence d’une telle finalité est particulièrement importante, car elle conditionne l’application d’autres principes du RGPD, dont notamment :

– Le principe de transparence (l’objectif du traitement doit être porté à la connaissance des personnes concernées afin qu’elles soient en mesure de connaître la raison de la collecte des différentes données les concernant et de comprendre l’utilisation qui en sera faite),

– Le principe de minimisation (les données sélectionnées doivent être adéquates, pertinentes et limitées à ce qui est nécessaire au regard des objectifs pour lesquels elles sont traitées),

– Le principe de limitation des durées de conservation (les données ne peuvent être conservées que pour une durée limitée qui doit être définie selon l’objectif pour lesquelles elles ont été collectées).

Deepeo prend en compte ces grands principes tout comme l’anonymisation ou la suppression des données personnelles en entreprise.

La CNIL donne quelques exemples de finalités considérées comme conformes : « Développement d’un modèle de reconnaissance vocale capable d’identifier un locuteur, sa langue, son âge, son genre, etc. », ou bien encore : « Développement d’un modèle de vision par ordinateur capable de détecter différents objets comme des véhicules (voitures, camions, scooters, etc.), des piétons, du mobilier urbain (poubelles, bancs publics, abri-vélos, etc.) ou des éléments de signalisation routière (feux tricolores, panneaux routiers, etc.) ».

Réaliser une analyse d’impact sur la protection des données (AIPD)

La constitution d’une base de données pour l’apprentissage d’un système d’IA peut engendrer un risque élevé pour les droits et libertés des personnes. Dans ce cas, une analyse d’impact sur la protection des données (AIPD) est obligatoire.

Une AIPD permet notamment de réaliser un recensement et une évaluation des risques pour les personnes dont les données pourraient être collectées, au moyen d’une analyse de leur vraisemblance et gravité, mais aussi d’effectuer une analyse des mesures permettant aux personnes d’exercer leurs droits, ainsi qu’une évaluation de la maîtrise des personnes sur leurs données et une évaluation de la transparence du traitement de données pour les personnes (consentement, information, etc.).

Le Comité européen de la protection des données (CEPD) a identifié neuf critères permettant d’aider les responsables de traitement à déterminer si une AIPD est requise : tout traitement remplissant au moins deux critères de cette liste sera présumé soumis à l’obligation de réaliser une AIPD. Certains de ces critères sont particulièrement pertinents pour la phase de développement :

– La collecte de données sensibles ou de données à caractère hautement personnel (catégories de données qui peuvent être considérées comme augmentant le risque d’atteinte aux droits et libertés des personnes, telles que des données de localisation ou des données financières, par exemple),

– La collecte de données personnelles à large échelle,

– La collecte de données de personnes vulnérables, comme par exemple les personnes mineures,

– Le croisement ou la combinaison d’ensembles de données,

– L’utilisation innovante ou l’application de nouvelles solutions technologiques ou organisationnelles.

Une fois le niveau de risque déterminé, il convient de concevoir dans l’AIPD un ensemble de mesures visant à le réduire et à le maintenir à un niveau acceptable. Ces mesures doivent intégrer les recommandations de la CNIL venant à s’appliquer, qu’elles portent sur les techniques d’IA utilisées ou non.

Certaines mesures spécifiques au domaine de l’IA – en particulier d’ordre technique – pourront être mises en œuvre, parmi lesquelles :

– Des mesures de sécurité, telles que le chiffrement homomorphe ou l’utilisation d’un environnement d’exécution sécurisé,

– Des mesures de minimisation, telles que le recours à des données synthétiques,

– Des mesures d’anonymisation ou de pseudonymisation, telles que la confidentialité différentielle,

– Des mesures de protection des données dès le développement, telles que l’apprentissage fédéré,

– Des mesures facilitant l’exercice des droits ou les recours pour les personnes, telles que les techniques de désapprentissage machine, ou les mesures d’explicabilité et de traçabilité des sorties du système d’IA,

– Des mesures d’audit et de validation, notamment pour identifier et corriger les biais ou les erreurs en défaveur de certaines personnes ou catégories de personnes.

Réflexion préalable sur la conception du système

Enfin, pour assurer le développement d’un système d’IA respectueux de la protection des données, il est nécessaire de mener une réflexion préalable lors de la conception du système. Lors de cette réflexion autour des choix de conception, les principes de protection des données, et en particulier le principe de minimisation, doivent être respectés. Cette démarche s’opère à cinq niveaux. Un responsable de traitement doit ainsi s’interroger sur :

– L’objectif du système qu’il souhaite développer,

– L’architecture technique du système qu’il cherche à concevoir et qui aura une incidence sur les caractéristiques de la base de données,

– Les sources de données mobilisées,

– Parmi ces sources, la sélection des données strictement nécessaires, au regard de l’utilité des données et de l’impact potentiel que leur collecte fait peser sur les droits et libertés des personnes concernées,

– La validité des choix précédemment opérés. Cette validation peut prendre différentes formes (non exclusives) telles que la réalisation d’une étude pilote ou l’avis d’un comité d’éthique.

Le développement de systèmes d’IA est conciliable avec les enjeux de protection de la vie privée. Encore faut-il respecter un certain nombre de règles et de principes garantissant que les dispositifs, outils et applications développés sont fidèles aux valeurs prônées par le RGPD.

Pour aller plus loin, découvrez notre solution logicielle :

Le portail deepeo :

· Obtenez une vue d’ensemble des données stockées dans votre organisation.

· Visualisez les indicateurs clés (nombre de suppressions, taux de risque, nombre de données personnelles traitées).

· Administrez des agents à distance.

· Définissez et configurez les règles de gestion.

· Créez des flux de travail et des alertes personnalisables.